论文A Library for Learning Neural Operators提出了名为 NeuralOperator 的开源库,用于学习和应用神经算子模型。NeuralOperator 通过模块化设计和高效实现,显著降低了神经算子模型的应用门槛,为科学计算与机器学习的结合提供了强大的工具。无论是学术研究还是工业应用,该库都展现了强大的适应性和实用价值。

论文作者为,来自Jean Kossaifi, Nikola Kovachki, Zongyi Li, David Pitt, Miguel Liu-Schiaffini, Robert Joseph George, Boris Bonev, Kamyar Azizzadenesheli, Julius Berner, Anima Anandkumar,来自NVIDIA和Caltech。

1. 背景与问题定义

科学计算中的许多问题都涉及函数之间的映射,例如偏微分方程(PDEs)的求解。这些问题通常需要高分辨率的离散化方法来获得精确的结果,但计算代价高昂。以天气模拟为例,网格的分辨率显著影响计算复杂度,从而限制了在大范围参数空间上的快速仿真能力。

传统方法的局限性

- 数值方法:依赖于固定的网格离散化,其准确性和分辨率直接相关,难以扩展到大规模问题。

- 传统神经网络:只能在固定维度的输入和输出上进行学习,无法泛化到不同分辨率的数据。因此,生成的模型在处理超分辨率或低分辨率的任务时表现较差。

神经算子的提出

为了解决上述问题,神经算子(Neural Operators)被引入。这种方法不同于传统神经网络,通过直接学习函数空间之间的映射(即无限维空间),实现对任意分辨率输入的兼容性。它们能够保证离散化收敛性,即随着输入离散化精度的提高,预测结果逐渐逼近真实解。

2. 神经算子简介

核心思想

- 神经算子通过构造可学习的积分变换,实现从输入函数到输出函数的映射。这一过程不受输入数据分辨率的约束,能够泛化到任意离散化的网格。

- 与传统方法相比,神经算子在离散化精度变化时仍能保持较高的准确性。

代表性架构

- Fourier 神经算子(FNO):通过快速傅里叶变换(FFT)实现积分核的高效计算。

- 图神经算子(GNO):允许在任意几何结构上进行学习。

- 球面 Fourier 神经算子(SFNO):基于球面谐波变换,用于球面上的数据处理。

- 几何感知神经算子(GINO):结合 GNO 和 FNO 的优势,适应复杂几何。

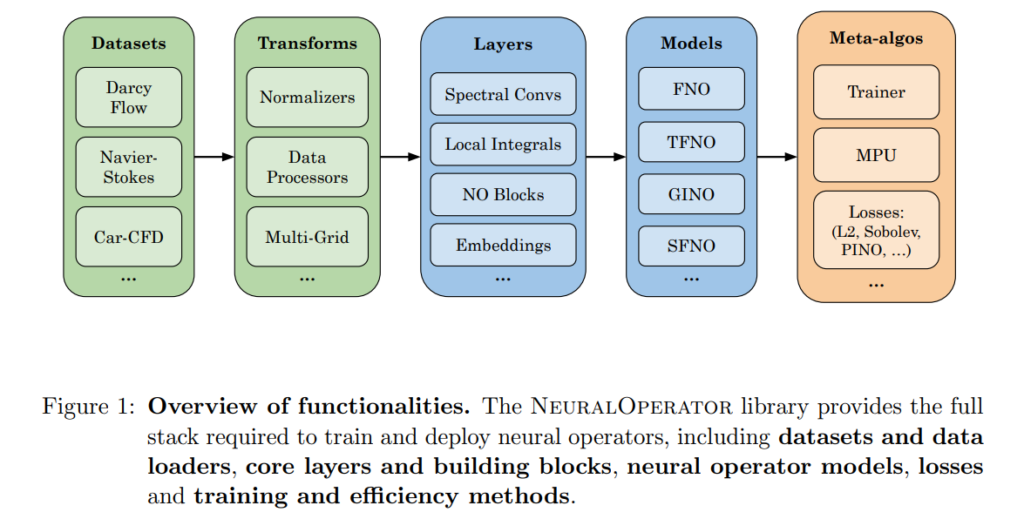

3. NeuralOperator 库的主要功能

3.1 模块化设计

NeuralOperator 提供了一整套高效、可靠、易用的工具,用于构建、训练和部署神经算子模型:

- 分辨率无关性:所有模块支持任意分辨率的输入输出,包括超分辨率任务。

- 预构建模块:实现了广泛的神经算子架构和构建块,如积分变换、位置嵌入、点运算等。

- 训练自动化:内置的训练器模块(Trainer)能够简化标准训练流程,包括数据预处理、模型优化和验证。

3.2 神经算子架构

- Fourier 神经算子(FNO):通过 FFT 加速积分核的计算,适合规则网格。

- Tensorized FNO (TFNO):利用张量分解减少模型参数量,同时优化内存和计算效率。

- Spherical FNO (SFNO):用于球面数据的高效建模,支持球面谐波分析。

- 增量学习与多网格方法:通过多网格域分解和增量训练,实现大规模问题的高效求解。

3.3 数据支持

NeuralOperator 提供了常见 PDE 数据集的接口,涵盖以下内容:

- Darcy 流体模型:解决地下水流动问题。

- Navier-Stokes 方程:用于二维和三维流体动力学的模拟。

- 车辆 CFD:通过车身表面流场模拟进行空气动力学优化。

3.4 性能优化

- 张量化(Tensorization):通过张量分解减少参数量,提高训练和推理效率。

- 混合精度训练:利用 PyTorch 的原生支持,减少内存占用,同时提升计算速度。

- 分布式计算:内置多网格域分解方法,支持大规模分布式训练。

3.5 灵活性与可靠性

- 模块化设计使得用户可以根据需要自由组合和扩展各功能模块。

- 所有核心功能均经过单元测试验证,并通过持续集成(CI/CD)管道确保代码质量。

4. 实验与应用

虽然论文未详细展开实验部分,但提到了一些潜在应用场景:

- 科学计算:神经算子能够高效求解流体动力学、传热传质等复杂 PDE 问题。

- 工业设计:通过车身空气动力学优化,缩短设计周期。

- 物理模拟:在气候模拟、材料科学等领域,用于快速预估和优化。

5. 与现有工具的比较

优点

- 通用性:支持不同类型的网格和几何结构。

- 高效性:结合 FFT 和张量分解等技术,实现高效计算。

- 易用性:提供开箱即用的模块和简洁的接口。

不足与挑战

- 应用门槛:尽管提供了详细文档,新用户可能需要一定学习时间。

- 性能局限:对极高分辨率或特定几何问题的扩展性仍需进一步研究。

6. 未来展望

架构扩展:随着神经算子领域的快速发展,NeuralOperator 计划加入更多先进模型,例如基于 Transformer 的神经算子。

跨领域应用:进一步探索在量子计算、金融建模、生物医学等领域的应用可能性。

社区发展:通过开放社区合作,推动神经算子研究的标准化和生态系统建设。

NeuralOperator Lib on GitHub: https://github.com/neuraloperator/neuraloperator