Smart Bird Feeder 智能鸟食器:有趣、有创意的物联网产品

Bird Buddy 是一家成立于 2020 年的科技创业公司,总部位于斯洛文尼亚卢布尔雅那,并在美国密歇根州...

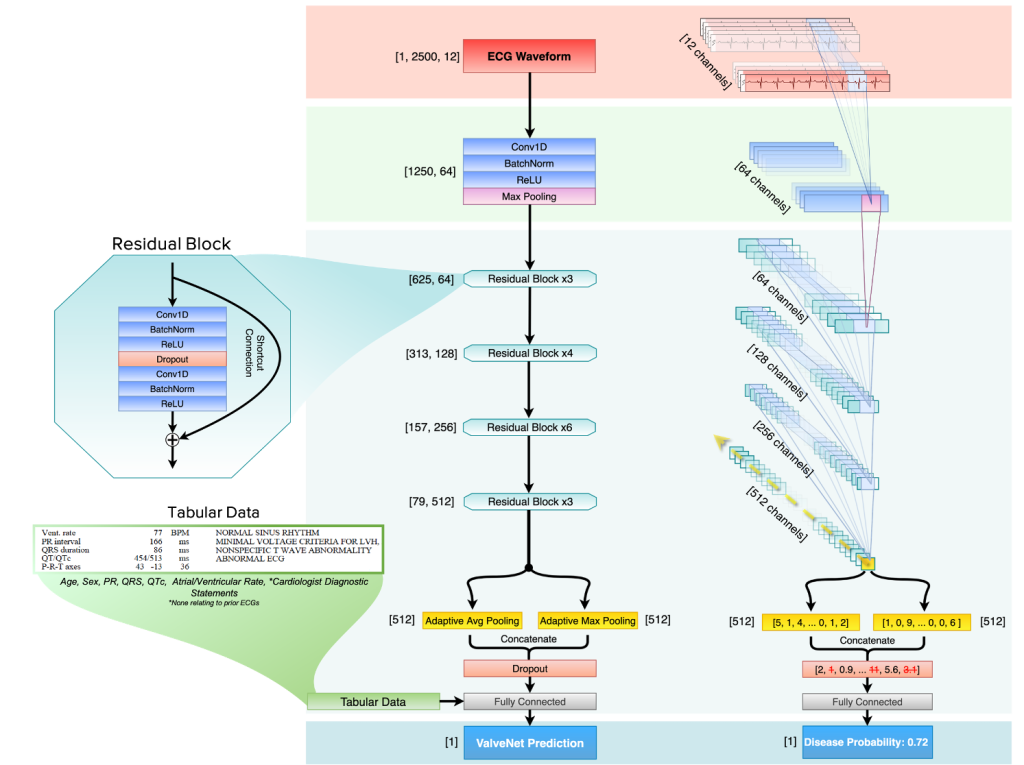

Read MoreEchoNext:利用心电图(ECG)检测结构性心脏病(Structural Heart Disease, SHD)的AI模型

论文Detecting structural heart disease from electrocardio...

Read MoreAI让我们“认知卸载”(Cognitive Offloading)?

所谓“认知卸载”(cognitive offloading),是指人类将原本需要靠自己记忆、推理或判断的认知任...

Read MoreCheMeleon:基于分子描述符,可快速准确预测分子性质的创新模型

使用机器学习快速且准确地预测分子性质,对于多个科学领域的进步具有关键意义。尤其是基础模型(Foundation...

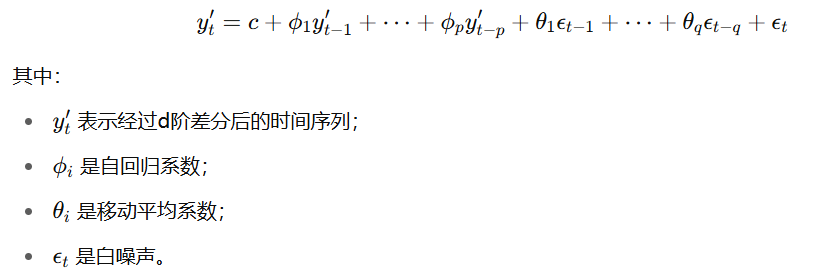

Read More浅谈ARIMA(AutoRegressive Integrated Moving Average,自回归滑动平均整合模型)

ARIMA(AutoRegressive Integrated Moving Average,自回归滑动平均整...

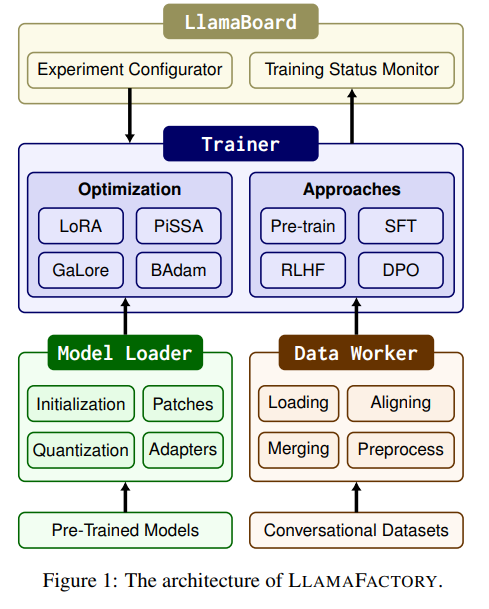

Read MoreLLaMAFactory:支持超过100种大模型的LLM高效微调框架

论文LlamaFactory: Unified Efficient Fine-Tuning of 100+ L...

Read More彼得·蒂尔(Peter Thiel)的提醒:看似保障‘和平与安全’的体系,其实可能变成禁锢人类未来的牢笼。

近日,彼得·蒂尔(Peter Thiel)与《纽约时报》专栏作家罗斯·道森(Ross Douthat)进行了对...

Read More