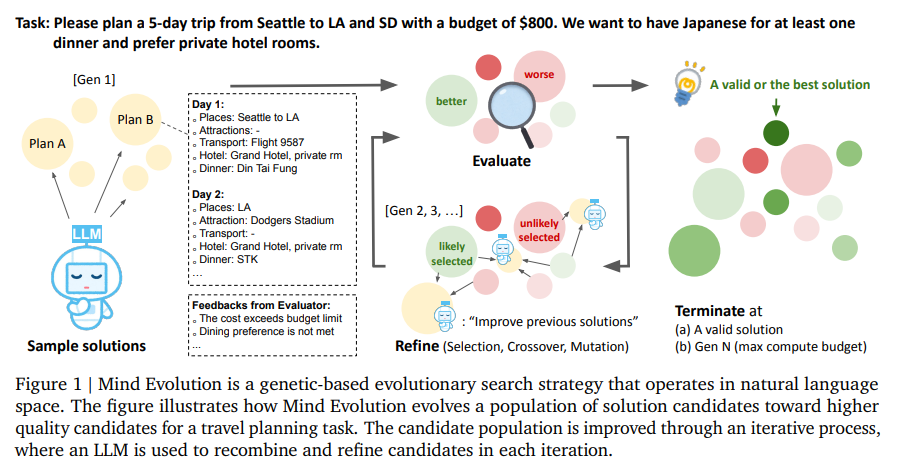

Mind Evolution:结合基因搜索算法与LLM的生成能力,利用进化策略在自然语言空间中高效搜索解决方案

论文Evolving Deeper LLM Thinking提出了一种创新的进化搜索策略——Mind Evol...

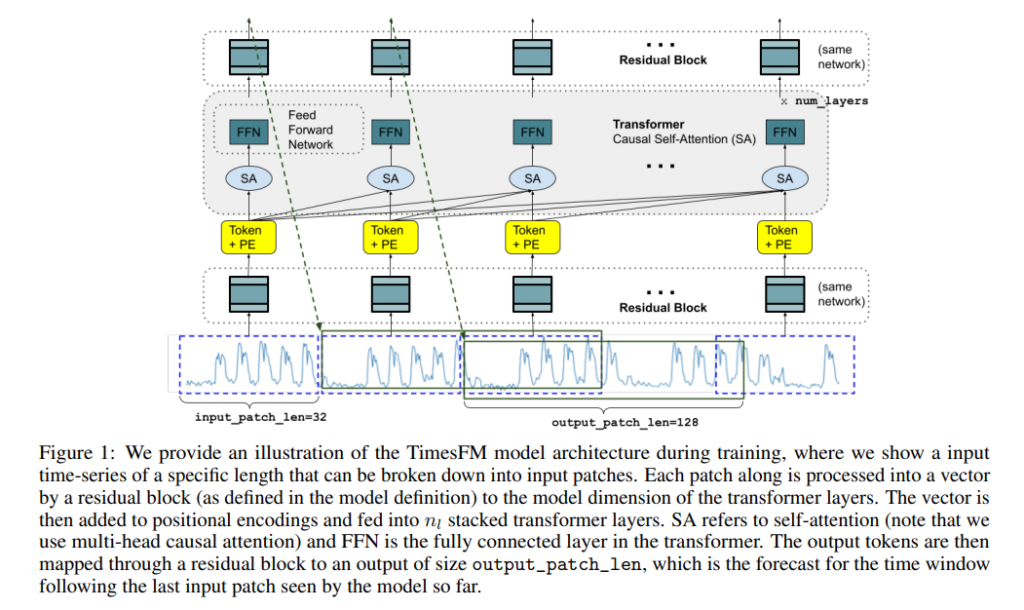

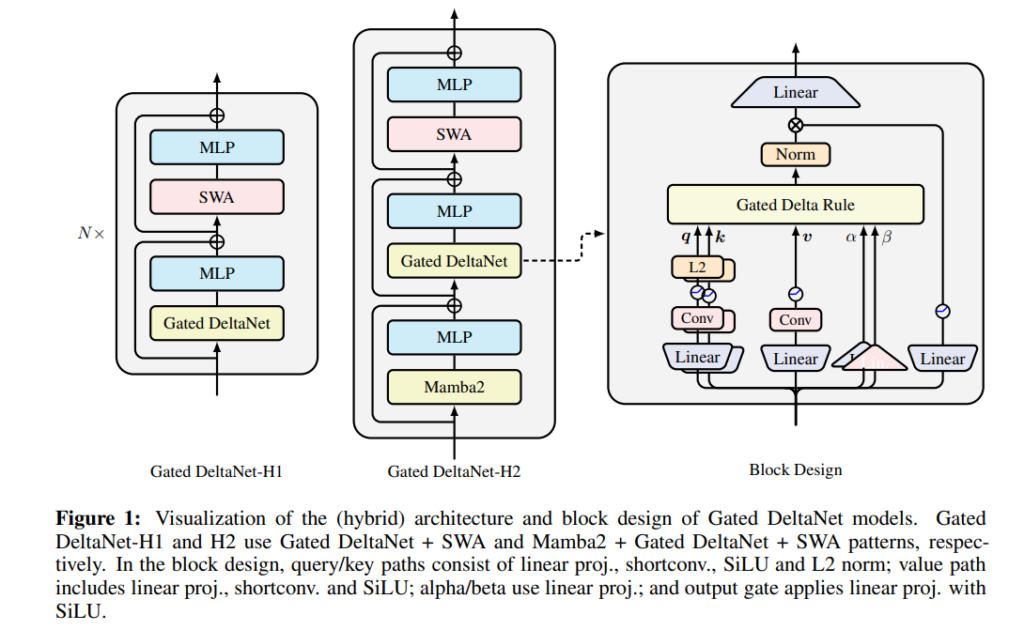

Read MoreGated DeltaNet架构:结合门控机制和Delta更新规则,提升线性Transformer在长序列建模和信息检索任务中的表现

论文Gated Delta Networks: Improving Mamba2 with Delta Rul...

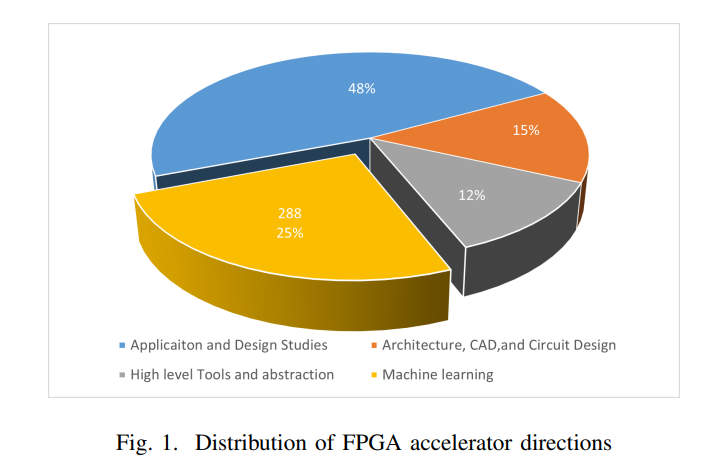

Read More基于现场可编程门阵列(FPGA)机器学习(ML)加速器的研究现状及发展趋势

论文A survey on FPGA-based accelerator for ML models对基于现场...

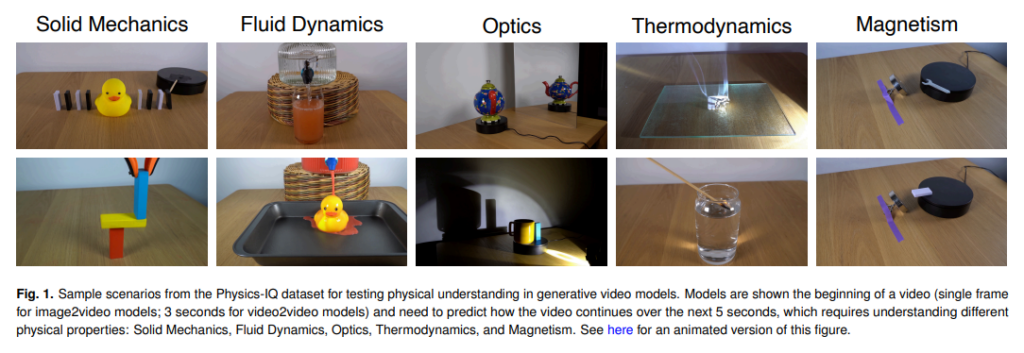

Read MorePhysics-IQ(物理智商?)基准数据集:测试生成性视频模型在理解物理原则方面的能力

论文Do generative video models learn physical principles...

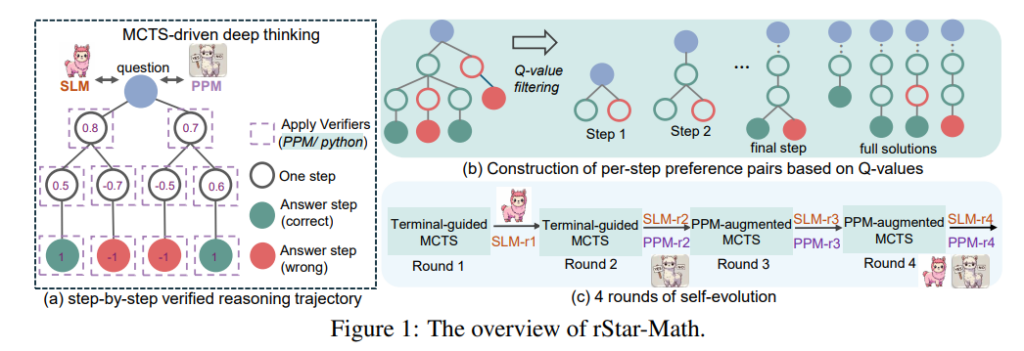

Read MorerStar-Math:有效提升小型语言模型(Small Language Models, SLMs)在数学推理任务中的表现

论文rStar-Math: Small LLMs Can Master Math Reasoning with...

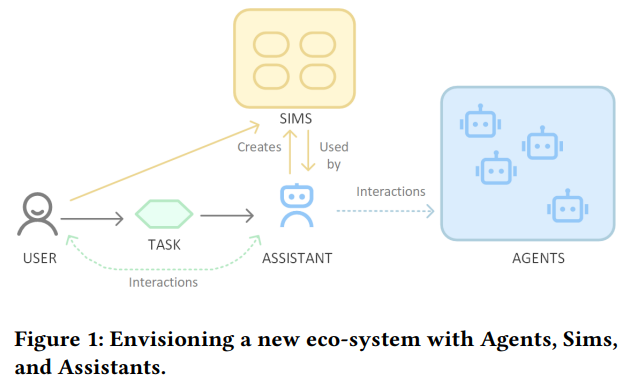

Read More智能代理(Agents)+用户偏好模拟(Sims)+助理(Assistants)=新型智能代理生态系统

论文Agents Are Not Enough认为,仅具有代理能力不足以解决问题,构建一个包含智能代理、用户偏...

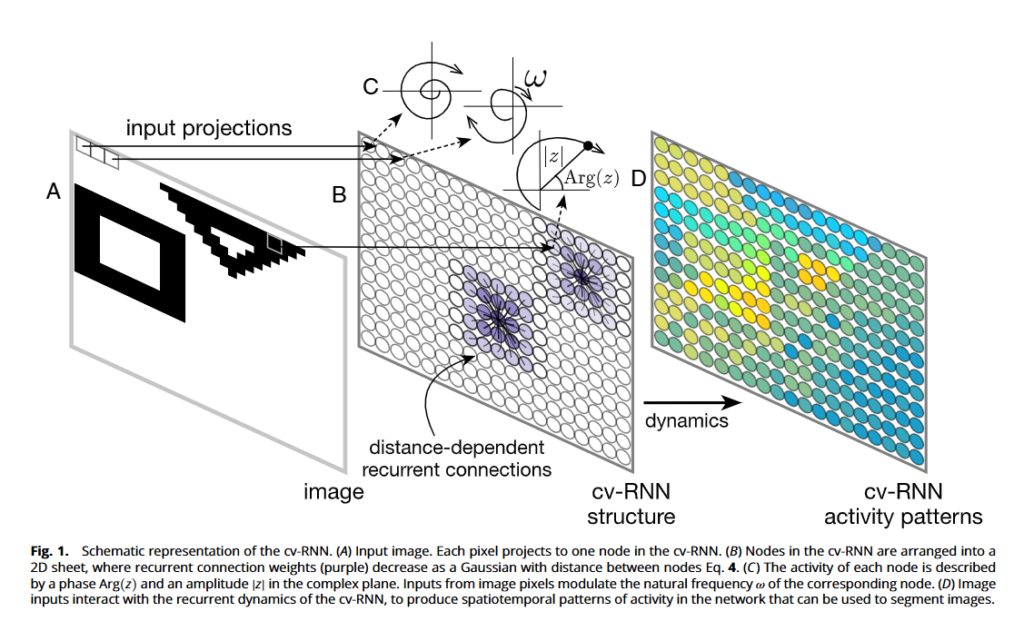

Read More复值循环神经网络(Complex-Valued Recurrent Neural Network,cv-RNN):从数学层面理解神经网络的决策过程

论文Image segmentation with traveling waves in an exactly...

Read MoreFACTS Grounding:用于评估大型语言模型(LLMs)基于长文档生成事实性(factuality )准确回答能力的基准测试

幻觉(Hallucinations,即事实性不准确的回答)依然困扰着大型语言模型(LLMs)。尤其是在面对更复...

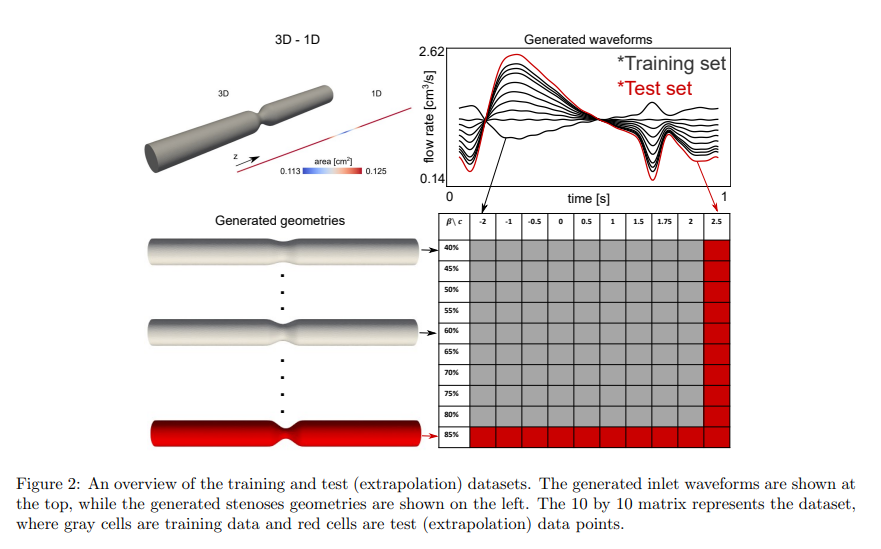

Read MorePCNDE框架(Physics-constrained coupled neural differential equations,物理约束神经微分方程):实现较高精度和计算效率的1D血流模型

论文Physics-constrained coupled neural differential equat...

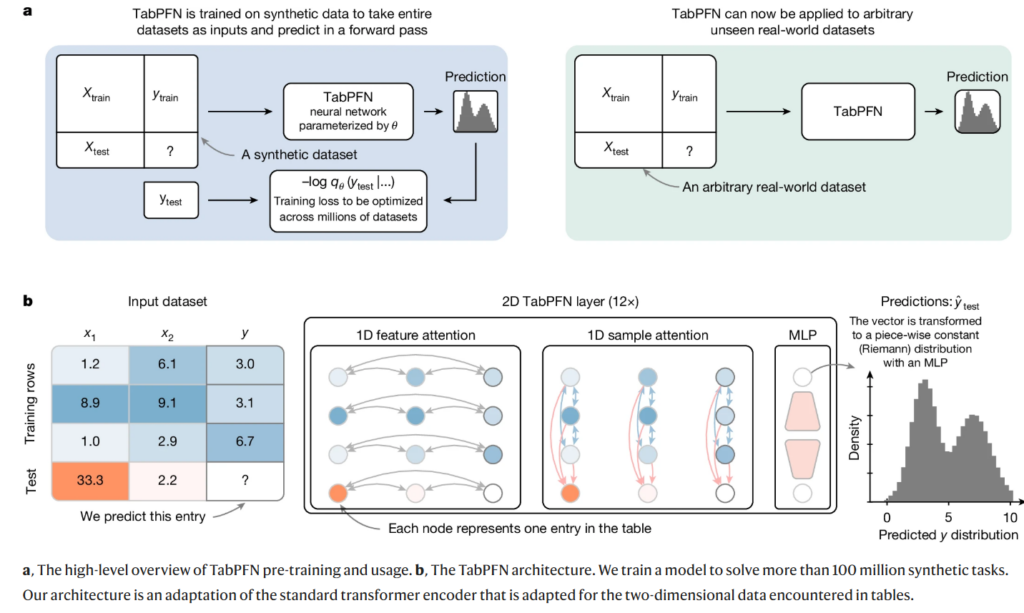

Read MoreTabPFN(Tabular Prior-data Fitted Network),这是一种基于生成式Transformer模型的表格数据基础模型

论文Accurate predictions on small data with a tabular fou...

Read More浅谈In-Context Learning (ICL),“上下文学习” 、 “情境学习”或者“内在学习”

In-Context Learning (ICL) 可翻译为 “上下文学习” 、 “情境学习”或者“内在学习”...

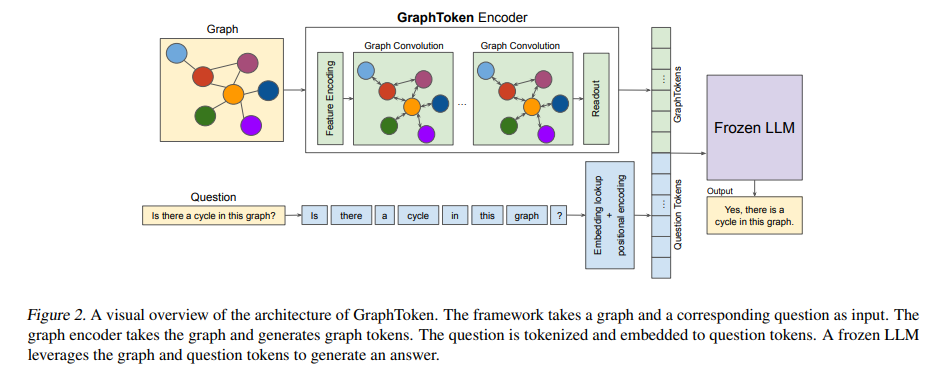

Read MoreGraphToken:实现图推理(graph reasoning)能力显著提升

论文Let Your Graph Do the Talking: Encoding Structured Da...

Read MoreNVIDIA推出Cosmos世界基础模型(World Foundation Model)平台

NVIDIA 宣布推出 NVIDIA Cosmos™,一个包含最先进的生成性世界基础模型、先进的标记器、保护机...

Read More