近期,在一次真实的火星地表行驶演示中,NASA / Jet Propulsion Laboratory团队首次让“生成式 AI”承担了以往由人类路线规划师完成的关键工作——根据轨道影像与地形数据,自动生成一串可执行的行驶“航点”(waypoints),并最终把指令上传给火星车(Perseverance Rover,毅力号火星车)完成行驶。

- 这次“AI 规划行驶”演示在 2025-12-08 和 2025-12-10 执行,地点在 Jezero Crater 边缘地带。

- 使用的是一种“能看图也能理解文本”的生成式 AI(vision-language models,VLM),从任务数据集中读取与人类规划师相同的影像/数据来产出航点。

- 这项工作由 Rover Operations Center 牵头,并与 Anthropic 合作,使用其 Claude 模型。

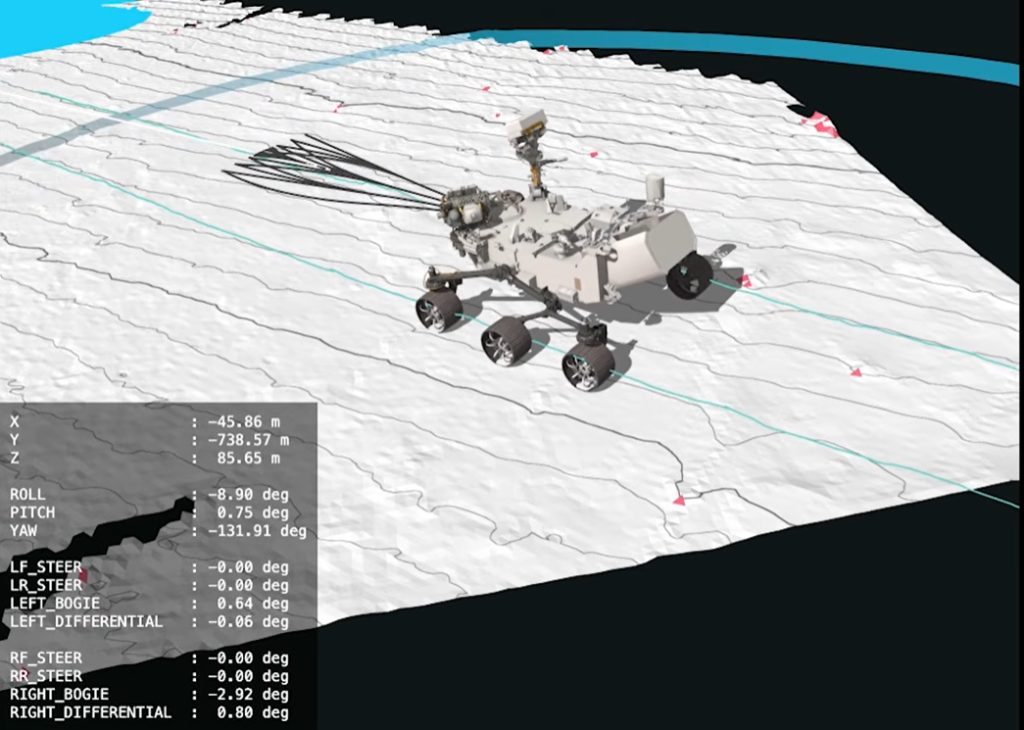

- 为了确保安全与兼容性,工程团队把生成的驱动指令先放进 JPL 的“数字孪生”环境中验证,检查了超过 50 万个遥测变量后才上传到火星。

- 两次行驶距离分别约 210 m(689 英尺)与 246 m(807 英尺)。

从NASA发布的新闻稿描述来看,这不是“让车载大模型在火星上即兴开车”,而更像是把 AI 嵌进地面作业链路,替换/加速“地面路线规划”这个最耗人力的环节:

- 输入数据:高分辨率轨道影像 + 数字高程/坡度等地形数据,如轨道相机影像与地形坡度数据。

- 感知与语义化:AI 识别关键地貌要素(如基岩、露头、危险巨石区、沙纹等),相当于把“工程师看图做判断”的过程自动化。

- 规划输出:生成一条连续路径并离散为航点序列,满足飞控/地面系统对指令结构的要求。

- 强验证闭环:在数字孪生里做高强度兼容性/安全性校验(>50 万遥测变量),再通过深空通信链路上传。

可以这样理解:AI 在“看图→选路→落点”的决策层帮你把草案画出来,但工程团队仍用严格的仿真/校验门禁把关。这也是为什么新闻里会强调“谨慎、负责任地在真实任务中应用新技术”。

此次任务的价值体现在如下三个方面:

1)把“28 年来的人工驾驶工作流”往自动化推了一步

火星与地球平均距离远、通信有延迟,无法实时手柄操控;传统上需要人类驾驶员分析地形与车辆状态,用航点“分段”规划并上行执行。 这次演示证明:至少在部分场景里,生成式 AI 能把这段工作显著“机器化”。

2)面向更长距离、更高频的探索节奏

JPL 的 Vandi Verma 提到,生成式 AI 有望帮助离星驾驶的三大支柱:感知、定位、规划控制,从而走向“公里级”行驶、降低操作员负担,并从海量图像中标记科学兴趣点。

3)ROC 的定位暗示:这不是一次性 Demo,而是面向“月球—火星地表体系化作业”的能力栈

ROC 页面把自己定位为面向未来漫游车/飞行器/地表任务的“卓越中心”,强调支持合作伙伴与技术转移,并在工具链上推进数字孪生、任务适配 AI、边缘 AI 增强的自主栈等。

这意味着:未来可能出现“地面 AI 辅助规划 + 车载自主避障/局部重规划”的更紧耦合形态。

此次任务的安全边界包括:

- 生成式 ≠ 可直接信任:要经过数字孪生里大规模遥测校验才敢上行,说明系统工程上仍把它视作“可疑输入”,需要门禁。

- 输入数据有盲区:轨道影像/坡度模型再好,也可能漏掉细小松散物、局部陷车风险等;因此它更像“全局路线建议”,而不是替代所有近场驾驶判断。

- 最关键的工程挑战不在“会画路线”,而在“可验证、可解释、可合规地接入飞行软件链路”,具体包括任务的兼容性与验证流程等。

这次“首个 AI 规划的火星行驶”更准确的意义是:生成式 AI 首次进入深空任务的“真实作业流水线”,在严格仿真与系统工程门禁下,开始接管一部分高成本的地面路线规划工作——它不是取代人类与飞控,而是在“可控、可验证”的边界内,把探索效率往前推了一小步。