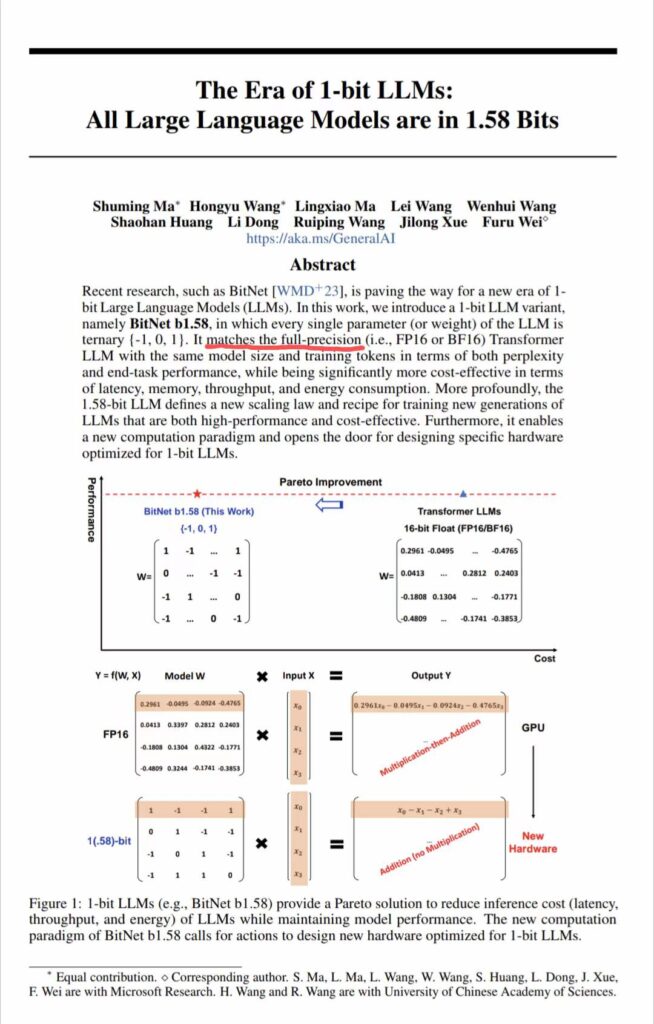

为提高性能,AI模型的权重值可把浮点数作整型化处理如Int8。这篇论文(The Era of 1-bit LLMs:All Large Language Models are in 1.58 Bits)的研究成果直接把权重简化到1.58位(即㏒₂³位,取值范围:-1,0,1),而模型推理的精度不降低。这个研究成果令人鼓舞和激动👍👍

1.58位的极简权重值将极大降低计算和能耗成本,但精度不降低还是令人将信将疑,或者说精度不降低的场景范围有限🤔。就好比黄金冶炼,纯度小数点后的9降低一位,成本指数级下降,但毕竟纯度下降了。