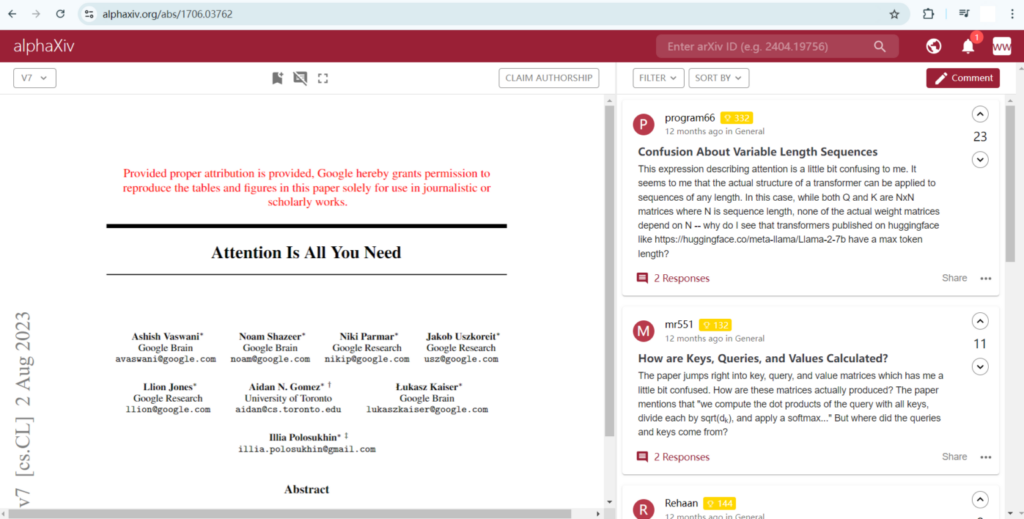

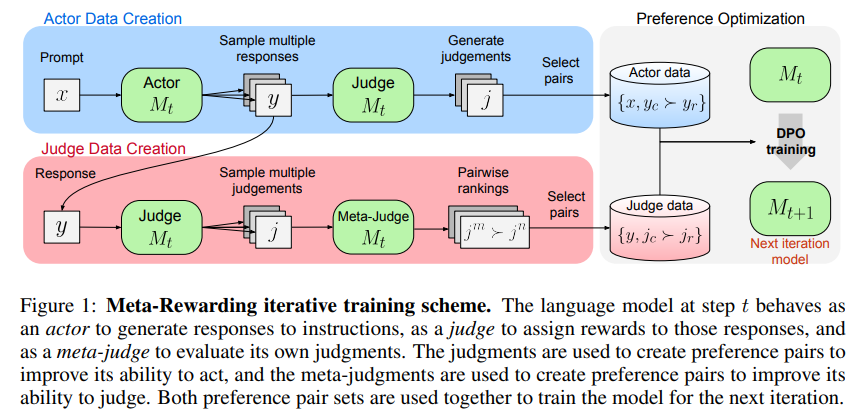

元奖励(Meta-Rewarding)模型:角色扮演(演员actor、评审judge和元评审meta-judge)的大语言模型

论文Meta-Rewarding Language Models: Self-Improving Alignm...

Read MoreYouTube-SL-25:一个大规模的开放领域多语言手语平行语料库

论文YouTube-SL-25: A Large-Scale, Open-Domain Multilingua...

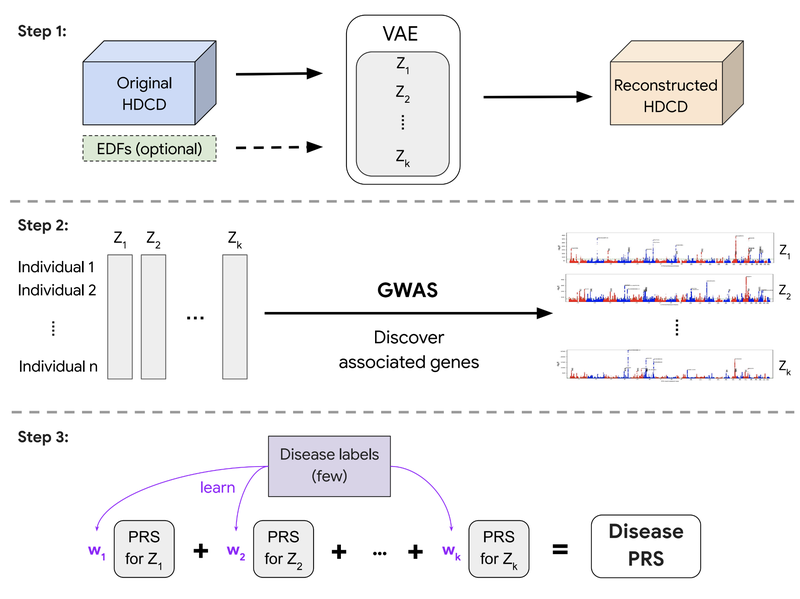

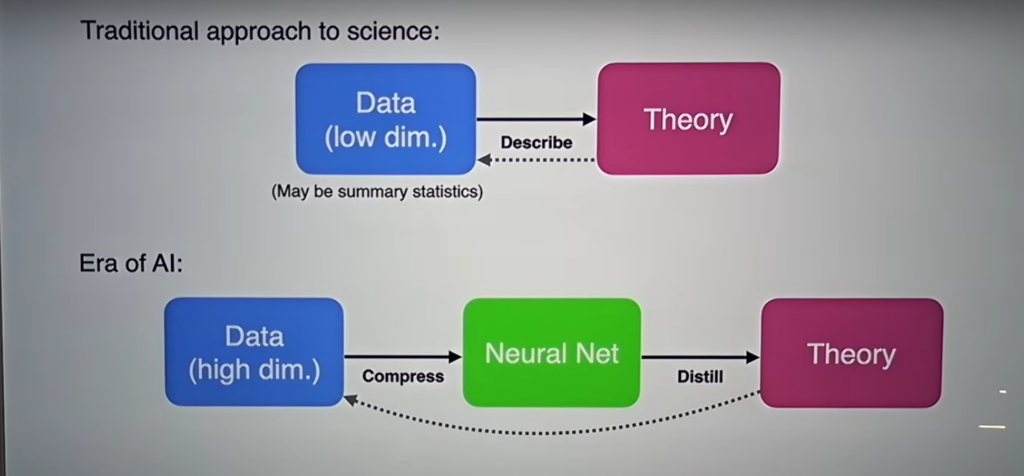

Read More一个典型的无监督深度学习成功研究案例:Unsupervised representation learning on high-dimensional clinical data improves genomic discovery and prediction

高维临床数据(HDCD)在生物银行(Biobank)级别的数据集中越来越多,但在遗传学研究中的应用仍具有挑战性...

Read MoreGBRL, Gradient Boosting Reinforcement Learning, 梯度增强强化学习

摘要 论文Gradient Boosting Reinforcement Learning介绍了梯度增强强化学...

Read More